Ihr nutzt die Search Console wie ein teures Fernglas – um dann konsequent in die falsche Richtung zu schauen. Ich hab‘s auch so gemacht. Jahrelang.

Heute machen wir Schluss mit dem „Dashboard öffnen, bisschen klicken, wieder schließen“ und schauen uns 10 versteckte Google Search Console Features an, die das SEO nicht nur messen, sondern im Zweifel wirklich retten.

Google Search Console ist das Tool, das wir alle haben, aber selten führen. Vergleichbar mit einem Feuerlöscher, den man dekorativ neben die Kerze stellt – bis die plötzlich zündet, alles in Brand setzt und dann alle hektisch googeln: „Wie benutze ich das Ding?“

Warum „Mastery“ hier nicht peinlich ist

„Mastery“ klingt nach Motivationsposter und Proteinshake. Ich weiß. Aber in der Search Console heißt es schlicht: Ihr hört auf, nur Symptome anzuschauen, und fangt an, Ursachen zu erkennen.

Die Search Console ist keine SEO-Orakel-Kugel, sondern ein System aus Berichten, Filtern und Diagnosen, das euch zeigt, was Google tatsächlich mit eurer Site macht – und zwar nicht als Bauchgefühl, sondern als messbare Realität.

Und weil ihr das hier vermutlich nicht zum Spaß lest – außer ihr seid so kaputt wie ich –, kommt gleich die zentrale Frage, die ich mir jedes Mal stelle:

Was ist gerade kaputt, was ist nur „ungeil“, und was ist ein reines Mess-Artefakt?

Was ist die Search Console?

Die Google Search Console (GSC) ist ein kostenloses Tool, mit dem ihr die Sichtbarkeit eurer Website in der Google Suche überwachen, Indexierungs- und Crawl-Probleme erkennen und Performance-Daten analysieren könnt.

First of all: Die Regex-Filter

Regex ist dieser Moment, in dem SEO kurz so tut, als wäre es Informatik. Und ich liebe es. Denn Regex (Regular Expressions) sind Muster, mit denen ihr in der Search Console nicht nur „enthält/ist gleich“ filtert, sondern ganze URL- oder Query-Familien herausfischt.

Und ja: Seit Google Search Console Features jetzt die Regex-Filter „enthält“ und „enthält nicht“ können, wird es richtig lustig – im Sinne von: endlich sauber ausschließen, was eure Analyse versaut.

Feature 1: Regex „stimmt nicht überein“ für saubere Analysen

Use Case: Ihr wollt wissen, wie eure Money Pages performen – aber die Daten werden von Branding-Queries, Login-URLs oder Tracking-Parametern kontaminiert.

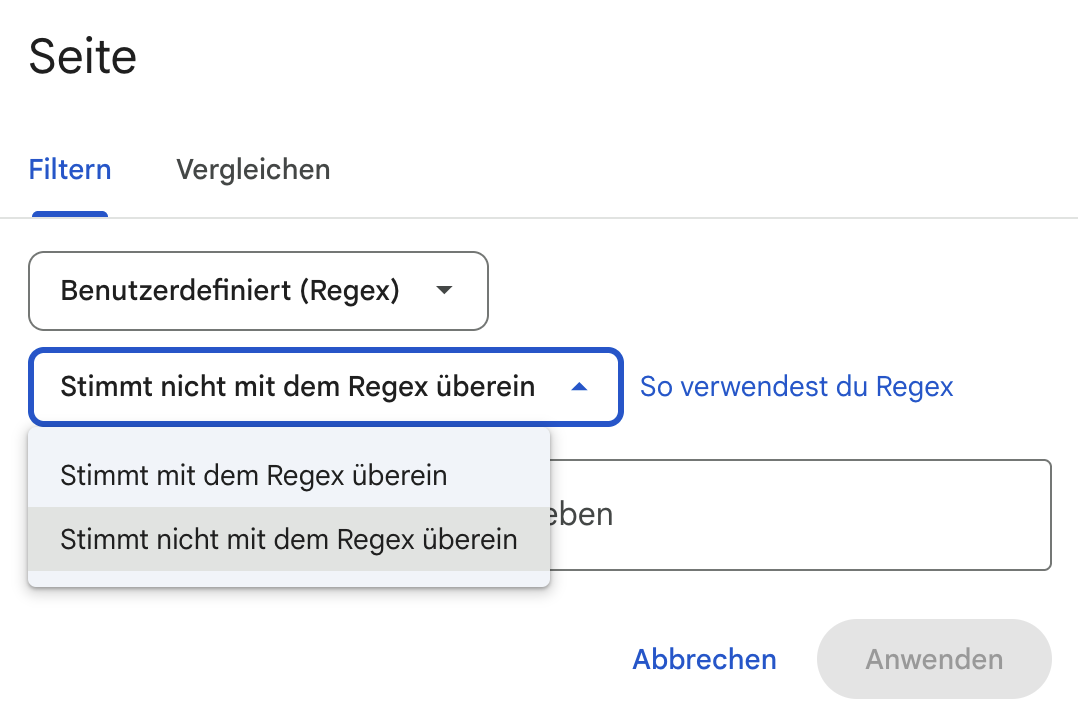

- Filter „Seite“ → „Benutzerdefiniert (Regex)“ → „Stimmt nicht mit dem Regex überein“: Schließt z.B. /login, /cart, /wp-admin oder Parameter-Schrott aus. Ihr kennt eure Baustellen.

- Filter „Suchanfrage“ → „Stimmt nicht mit dem Regex überein“: Entfernt Brand, Navigationsanfragen oder „Kontakt“-Noise, damit ihr die echten Nachfrage-Signale seht.

Feature 2: Regex als Intent-Scanner für KI- und Longtail-Anfragen

Use Case: Ihr wollt Queries finden, die wie Recherche-Prompts wirken und damit oft hohe Conversion-Absicht haben.

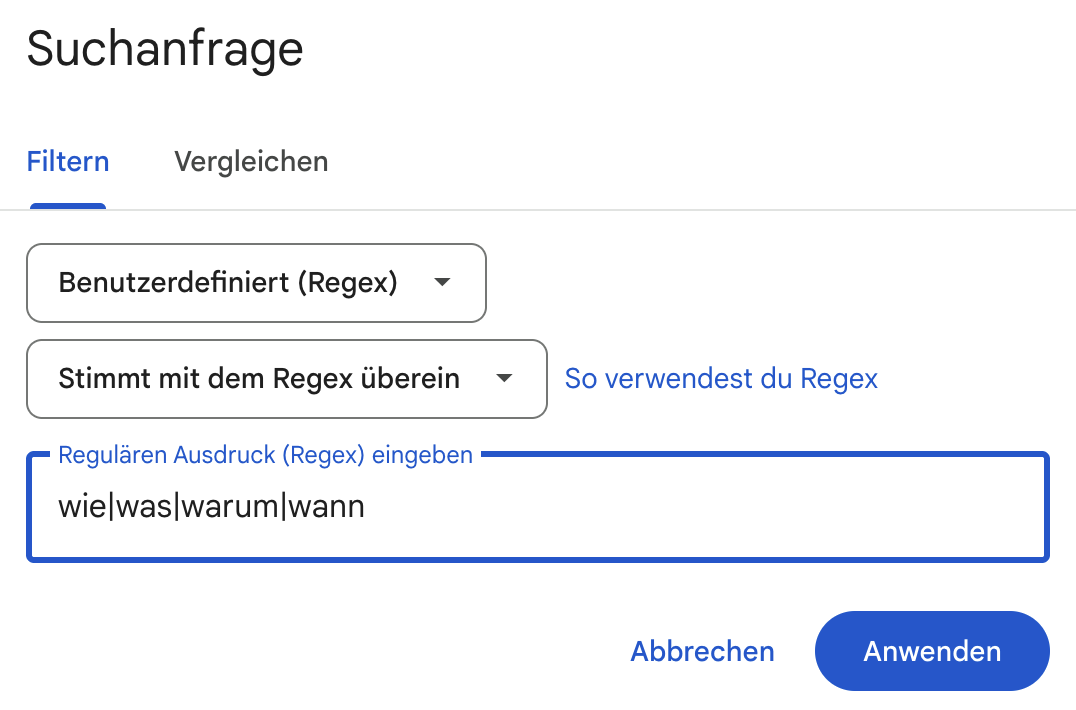

Suchanfragen-Regex: Findet Fragewörter wie wie|was|warum|wann*, Produktvergleiche vs|vergleich* oder Kaufintention preis|kosten|kaufen*.

* Die einzelnen Wörtern, werden mit dem Oder-Zeichen, dem „Pipe-Operator“, verknüpft. Sieht aus wie der Grobuchstabe „I“, ist aber senkrechter Strich.

GEO braucht Datenfutter, kein Gefühl

KI-Antwortsysteme lieben klare, überprüfbare Aussagen und stabile Seiten. Die Regex-Anfragen sind Google Search Console Features, die euch die Daten liefern, um Content und Technik gezielt zu justieren.

Wenn ihr GEO ernst meint, baut eine Antwort-Struktur in eure Inhalte und messt sie konsequent.

Weitere Tipps, Guides und Best Practices:

Feature 3: Regex für URL-Muster

Use Case: Ihr habt Parameter-URLs, Pagination, Facetten, Kampagnen-UTMs – und plötzlich rankt Google Dinge, die niemals das Licht der Welt hätten sehen sollen.

- Seiten-Regex: Isoliert Parameter-Seiten, z. B.

\\?als Zeichen für Query-Strings. - Erkennt Muster: Welche Parameter erzeugen Impressionen? Welche fressen Crawl-Ressourcen? Welche erzeugen Duplicate Content?

Feature 4 bis 5: URL-Prüfung

Die URL-Prüfungen sind die Google Search Console Featuers, die viele nur nutzen, um panisch zu fragen: „Bin ich indexiert?“ – und dann bei „Nein“ zu weinen.

Dabei ist das Ding viel mehr: Es zeigt Informationen zur indexierten Version und ermöglicht einen Live-Test, ob eine URL möglicherweise indexierbar ist, inklusive Hinweisen zu strukturierten Daten, Video, AMP und Mobile Usability.

Feature 4: Live-Test vs. indexierte Version – bewusst vergleichen

Der Live-Test prüft, ob Google die Seite aktuell abrufen und verarbeiten kann; die „indexierte Version“ zeigt, was Google derzeit im Index hat.

Diese Unterscheidung ist wichtig, weil „deployt“ nicht gleich „im Index angekommen“ ist.

Use Case: Ihr habt ein Canonical-Problem gefixt, aber Rankings bewegen sich nicht. Dann vergleicht ihr Live-Test mit Index-Version: Wenn das Live sauber ist, aber Index alt, ist es oft Geduld plus Crawl/Refresh-Thema – nicht „Fehler wieder da“.

Feature 5: Strukturierte Daten pro URL debuggen

In der URL-Prüfung seht ihr auch, welche strukturierten Daten (Schema) Google erkannt hat und ob sie valide sind – das taucht typischerweise im Bereich der Verbesserungen/Enhancements auf.

Use Case: Ihr habt FAQ/HowTo/Product-Schema eingebaut und wundert euch, warum nichts passiert. Ihr prüft URL → seht Fehler/Warnungen → fixt gezielt, statt im Blindflug „noch mehr Schema“ draufzukippen.

Feature 6: Der Indexierungsbericht – euer „Warum nicht?“

Der Page-Indexing-Report zeigt, welche Seiten Google indexieren konnte, welche ausgeschlossen sind und wo Fehler auftreten.

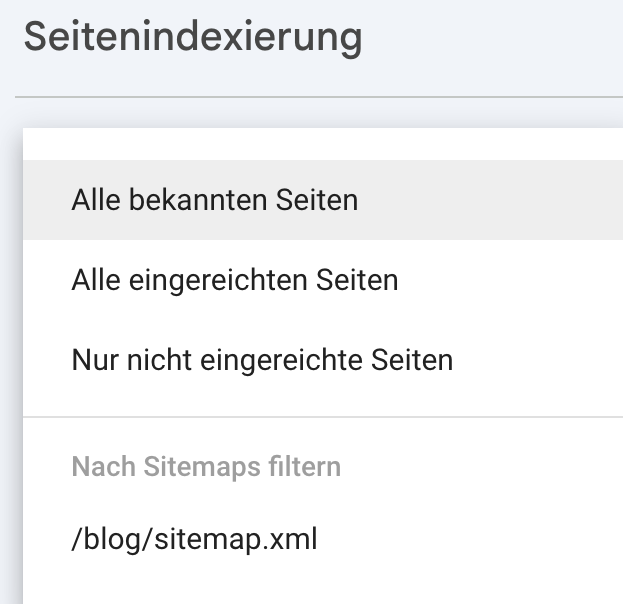

Was sagt euch „Alle bekannten Seiten“ vs. „Alle eingereichenten Seiten“?

Die Unterscheidung zwischen „Alle bekannten Seiten“ und „Alle eingereichten Seiten“ ist Gold, weil sie trennt: „Google hat es irgendwo gefunden“ vs. „Wir haben es aktiv in der Sitemap angeboten“.

Use Case: Viele ausgeschlossene URLs, aber nur in „Alle bekannten Seiten“. Das sind häufig Parameter, interne Suche, Filterseiten, technische Nebenprodukte.

Use Case: Probleme in „Alle eingereichten Seiten“. Dann brennt’s wirklich, weil ihr Google aktiv kaputte/unerwünschte URLs serviert.

Wenn ihr jetzt denkt: „Okay, aber was mache ich konkret?“ – gleich. Erst noch ein Satz Realismus: Nicht jede Exklusion ist ein Fehler. Manche sind Googles höfliche Art zu sagen: „Danke, nein.“

Mehr Tipps zur Google Search Console

Feature 7: Sitemaps – nicht einreichen, sondern überwachen

Der Sitemaps-Report zeigt Statuswerte wie „Erfolgreich“ oder „Konnte nicht abgerufen werden“ und dient dazu, neue Sitemaps zu übermitteln und Parsing-Fehler zu finden.

Use Case: „Erfolgreich“ heißt nicht „alles indexiert“. „Erfolgreich“ bedeutet: Google konnte die Sitemap abrufen und lesen. Nicht mehr.

Use Case: Sitemap-Format und Lesedatum als Release-Indikator. Im Report seht ihr auch den Zeitpunkt, wann Google die Sitemap zuletzt gelesen hat; das ist ein praktischer Indikator, ob Google eure neuen URL-Listen überhaupt „mitbekommen“ hat.

Feature 8: Crawl-Stats-Report – Serverdiagnose als SEO

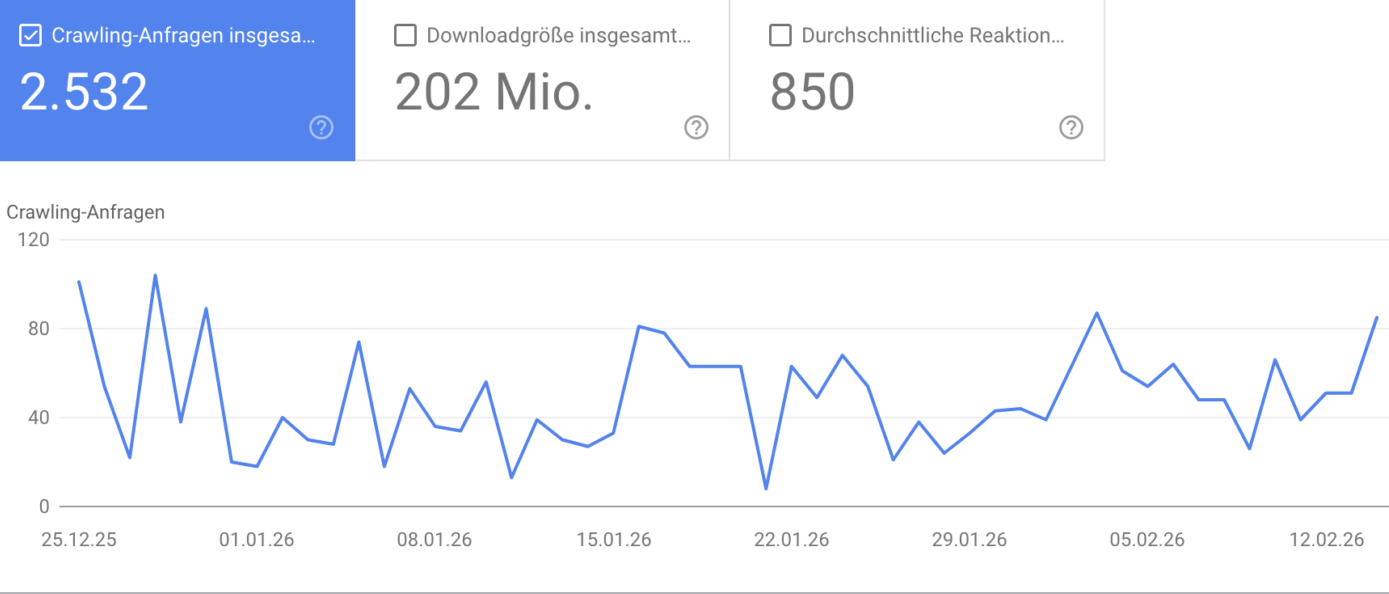

Der Crawl-Stats-Report zeigt euch Kennzahlen zu Googles Crawl-Historie: Gesamtanfragen, Downloadgröße, durchschnittliche Antwortzeit, Host-Status sowie Aufschlüsselungen nach Response, Dateityp, Crawl-Zweck und Googlebot-Typ.

Wo finde ich den Crawl-Stats-Report?

Ihr findet ihn in der Search Console unter „Einstellungen“ im Bereich Crawling, dort könnt ihr den Report öffnen.

Use Case: Das „SEO-Problem“ entpuppt sich als Infrastruktur-Thema. Wenn die durchschnittliche Antwortzeit hochgeht und gleichzeitig Crawl-Anfragen sinken oder 5xx-Responses zunehmen, ist das häufig kein „Content-Problem“, sondern ein Server-/Stabilitätsproblem. Der Crawl-Stats-Report gibt euch dafür genau die Dimensionen und Beispiele.

Und ja: Das ist der Moment, wo ich als Engineer kurz lächle, weil endlich mal nicht „Mach mehr Blogposts“ die Antwort ist, sondern „Fix deine Antwortzeiten“.

SEO stirbt selten am Keyword

Wenn eure Crawl-Stats kippen, kippt oft das ganze SEO-Narrativ gleich mit. Die Google Search Console ist dann weniger „Marketing“ und mehr „Incident Response“.

Mehr über Marketing-Methoden, Strategien und Insights gibt‘s hier:

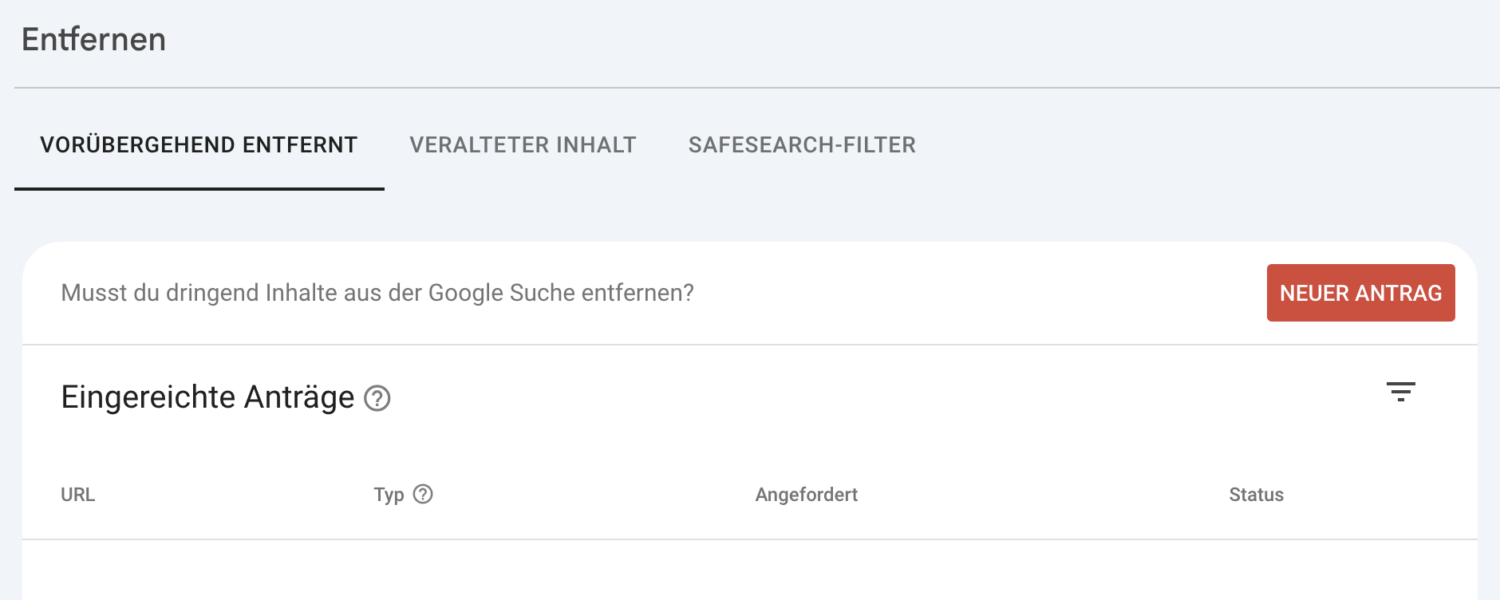

Feature 9: Entfernen – der rote Knopf, der nicht dauerhaft ist

Das Entfernen-Tool dient dazu, Ergebnisse von eurer Site temporär (bis ca. 6 Monate) aus der Google Suche zu blocken und außerdem SafeSearch-Themen zu verwalten sowie eine Historie der Anfragen zu sehen.

Wann ist Entfernen sinnvoll?

Wenn sensible oder falsche Inhalte akut aus den Suchergebnissen verschwinden sollen, kann Entfernen ein Notfallhebel sein – aber es ersetzt nicht die dauerhafte Lösung. Die wären: korrekter Statuscode, Zugriffsschutz, Noindex, Content-Entfernung.

Use Case: Ihr habt eine Staging-URL oder interne PDFs, die plötzlich ranken. Entfernen nimmt euch kurzfristig die Sichtbarkeit raus, während ihr die Ursache sauber behebt.

Feature 10: URL Inspection API für automatisierte Index-Checks

Mit der URL Inspection API könnt ihr per POST-Request unter anderem den Index-Status einer URL für eine Property abfragen (Endpoint: /urlInspection/index:inspect).

Use Case: Ihr habt 500 neue Produktseiten live gestellt und wollt nicht händisch 500-mal die URL-Prüfung aufrufen. Ihr baut euch ein kleines Script, das stichprobenartig oder nach Priorität checkt: indexiert ja/nein, Canonical-Signal, erkannte Probleme. Und ja: Das fühlt sich an wie eine Superkraft, ist aber legal.

Wichtig: Die API zeigt laut Google „presently only the status of the version in the Google index“ – also keine magische Live-Indexierbarkeit auf Abruf.

Ein Workflow, der nicht nach drei Tagen stirbt

Weil ihr nicht „noch ein Tool“ braucht, sondern ein System, hier mein Setup – pragmatisch, nervenschonend, KI-tauglich:

Wöchentlicher 30-Minuten-Check

- Performance: Regex-Filter für eure wichtigsten Verzeichnisse/Seitentypen; einmal „match“, einmal „not match“, damit ihr Noise entfernt.

- Indexierung: Blick auf „All submitted pages“ und die größten Ausschlussgründe; alles, was „wir eingereicht haben“ und trotzdem scheitert, ist High Priority.

- Crawl Stats: Kurz prüfen, ob Antwortzeit, 5xx oder Host-Status auffällig sind.

Fazit: Google Search Console Features

Und jetzt der Teil, den niemand hören will, aber alle brauchen: Mastery bedeutet nicht, dass nie etwas kaputt geht. Mastery bedeutet, dass ihr schneller merkt, was kaputt ist – und weniger Zeit damit verschwendet, auf die falsche Mauer einzuschlagen.

Wenn ihr nur eine Sache aus diesem Artikel mitnehmt: Nutzt die Google Search Console Features nicht als Tacho, sondern als Diagnosetool. Und wenn ihr heute Abend noch Energie habt: Baut euch einen Regex-Filter, der euch eure umsatzrelevanten Seitentypen isoliert. Morgen wirkt ihr plötzlich… kompetent. Aus Versehen.

Die Search Console ist nicht „ein Bericht“, sondern ein Werkzeugkasten – Regex bringt Ordnung in die Performance-Daten, URL-Prüfung zeigt euch die Wahrheit pro Seite, Indexierung trennt echte Probleme von Google-Entscheidungen, Crawl Stats entlarvt Infrastruktur-Bottlenecks, Removals ist der Notfallknopf, und die APIs machen aus Klickarbeit ein System.

Schreibe einen Kommentar