Wir erleben gerade einen literarischen Matrix-Moment. Large Language Models philosophieren heute so plausibel wie ich über Quantenphysik – also mit erstaunlich viel Selbstvertrauen. KI hat Sprache inzwischen so gut drauf, dass selbst Profi-Linguist*innen ins Schleudern kommen.

Einige Textanalyse-Tools – halb Sherlock Holmes, halb R2D2 – behaupten ernsthaft, sie könnten im epischen Duell um die Federhoheit zwischen menschlicher Wärme und maschineller Kälte unterscheiden.

Das ist ungefähr so zuverlässig wie eine Wettervorhersage für 2030 – nur mit weniger Wolken.

Moderne KI-Modelle schreiben inzwischen so flüssig, dass die selbsternannten Textdetektive stolpern. Und trotzdem gibt es Hinweise, Methoden und Tools, die fest davon überzeugt sind, im großen Duell zwischen menschlicher Kreativität und maschineller Rechenpower unterscheiden zu können.

Genau das schauen wir uns heute an. Eine Warnung vorab: Das Ganze ist ungefähr so sexy wie ein Taxonomie-Seminar.

Warum die Frage überhaupt relevant ist

Erst mal: Warum wollen wir überhaupt wissen, ob ein Text von einer KI stammt? Wir leben im Jahr 2026! Und laut einer aktuellen Studie stammen inzwischen mehr als die Hälfte aller neu veröffentlichten englischsprachigen Webartikel angeblich von Maschinen.

Bedeutet das, dass alles bald nach Bots riecht? Ja. Aber irgendwie auch nein. Die Sichtbarkeit dieser KI-Inhalte unterscheidet sich dramatisch. Menschlich redigierte Inhalte performen in Rankings oft besser – die werden zumindest eher zitiert, genutzt, verlinkt und zuletzt sogar von KI‑Systemen wiederverwendet.

Die Frage ist also keine nerdige Meta‑Diskussion, sondern durchaus business‑relevant: Nicht ob eine KI schreibt, sondern wie gut ein Text ist.

Mehr zum Thema SEO/GEO:

Wie funktionieren Tools zur KI Text Erkennung?

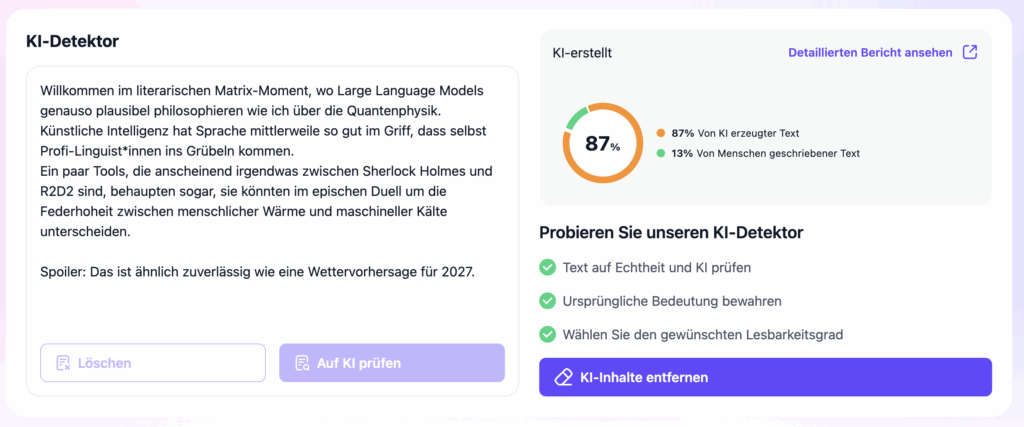

Tools wie JustDone, Originality.ai oder Copyleaks verkaufen sich als Text-Polizei. Sie arbeiten mit großen Trainingsdatensätzen, in denen sie menschliche und KI‑Texte verglichen haben. Damit lassen sie eine Wahrscheinlichkeit ausspucken: „78 % menschlich“, „87 % KI“ oder auch gern mal „Hm, schwer zu sagen“.

Die Grundidee dahinter ist immer gleich: KI-Modelle spinnen vorhersehbare Satzmuster, benutzen bestimmte Übergangsphrasen häufiger und weisen geringere Peaks auf – so die Theorie. Wenn ein Text nun aber zu … perfekt strukturiert ist, dann muss er ja von einer Maschine sein, oder?

Die überraschende Wahrheit über die Detektoren

Diese Detektoren sind total unzuverlässig. Selbst die großen Tools erzielen oft weniger als 80 % Genauigkeit, manche sogar deutlich darunter.

Schlimmer noch:

- Text, der von echten Menschen geschrieben wurde, wird häufig als KI Text erkannt, weil er strukturiert ist. Passiert mir zum Beispiel relativ oft in meinen Blogbeiträgen. Weil die – welch Überraschung – GEO-optimiert sind.

- KI‑Texte, die menschlich überarbeitet wurden, entkommen hingegen gerne der Erkennung.

- Hybridtexte verwirren jedes Tool komplett.

Kurz gesagt: KI‑Detektoren geben Hinweise – aber sie sind keine Autoritätsinstanz. Für eine echte Authentizitätsprüfung braucht es mehr Kontext, Meta‑Informationen und menschliche Expertise. Glaubt nicht blind, was ein Algorithmus ausspuckt, nur weil er „Detektor“ im Namen hat.

KI verstehen – jenseits von Detektoren

Dieser Beitrag zeigt, warum KI-Texterkennung keine Wahrheitsmaschine ist.

Und die meine KI-Übersichtsseite zeigt, was stattdessen zählt, wenn KI sinnvoll eingesetzt werden soll.

Erkennen Menschen die Autorenschaft besser als Detektoren?

Selbst Expert*innen – also Menschen – schneiden nur knapp über der Zufallslinie ab, wenn es darum geht, KI‑Generiertes zu identifizieren. In einer Studie erkannten Lehrende KI‑Texte mit etwa 57% Genauigkeit, was so zuverlässig ist wie ein 50‑Euro‑Würfel mit 60 Seiten.

Was bedeutet das? Der Unterschied zwischen „von Menschen geschrieben“ und „von KI generiert“ ist nicht nur ein paar statistische Merkmale oder Wortlängen – es ist ein fließender Übergang. Sprache ist Kontext, Subtext und stilistische Nuance. Besonders dann, wenn man sie ironisch und sarkastisch sezieren will. Genau das macht es so schwer.

Grenzen der KI Text Erkennung – und warum sie uns trotzdem beschäftigt

Wir leben in einer Welt, in der der Eindruck zählt. Google, Suchmaschinen und Redaktionen können zwar algorithmisch erkennen, ob Inhalte generisch oder qualitativ hochwertig sind – aber nicht, ob sie von einem menschlichen Geist kommen oder aus dem Silizium-Hirn eines Sprachmodells gefallen sind.

KI‑Text-Detektor*innen – aufgrund der Fehlerbilanzen schmeiße ich mal alle in einen Topf; die algorithmischen und die menschlichen – sind deswegen eher Indikator*innen als Richter*innen: Sie helfen bei der Einschätzung, nicht bei der Verurteilung.

Ein weiteres Problem: Je ausgefeilter die KIs werden, desto mehr ähneln ihre Texte menschlichem Stil – und desto weniger zuverlässig werden die Detektoren. Es ist ein Wettlauf wie zwischen einem Meisterdieb und einem immer besser werdenden Schloss.

Stilistische und inhaltliche Unterschiede zwischen Mensch und Maschine

Wenn man wirklich genauer hinschaut, gibt es einige Hinweise, wo – mit gesundem Menschenverstand – die Feder anders tanzt.

Menschen schreiben oft mit Emotion, Erfahrung, persönlicher Stimme oder kulturellen Nuancen. Maschinen hingegen … na ja … das sind halt Maschinen. Sie generieren ähnliche Satzstrukturen auf Basis großer Datenmengen. Die KI ist zum Beispiel fantastisch darin, Muster wiederzugeben, aber sie versteht nicht wirklich, was sie schreibt.

Wenn ich also in einem Satz „Ich liebe KI, aber sie klaut mir den Job“ schreibe, dann ist das kein bloßes Muster – es ist ironisch, paradox, menschlich. Wird ein Detektor das als „von einem Menschen“ einstufen? Vielleicht. Wird er es verstehen? Definitiv nicht immer.

Hier sind typische Unterschiede, die sich durch Beobachtung – nicht Algorithmen – erschließen:

- Menschliche Texte „leben“. Sie haben Unebenheiten, Überraschungen, innere Widersprüche, Wortwitze, kleine Unlogiken, die aber einen persönlichen Stil ausmachen.

- KI‑Texte wirken oft glatter, berechenbarer, manchmal zu optimal formuliert, so als hätte jemand einen Satzbau‑Diplomkurs gemacht und wäre nie auf eine Party eingeladen worden, auf der alle wild durcheinanderquatschen.

Ein Beispiel: Ein Mensch kann plötzlich mitten im Satz einen Scherz über die Axt 2000 einflechten, KI eher nicht – solange sie nicht explizit danach gefragt wird.

Automatische Tools hingegen scannen Wortmuster, Kohäsion, Wiederholungen und andere Merkmale. Wenn ein Text „zu perfekt“ wirkt – ohne stilistische Sprünge oder chaotische Gedanken – dann bekommt er schnell ein „wahrscheinlich KI“ Label. Das ist ein bisschen so, als würde man ein Gemälde danach beurteilen, ob jeder Pinselstrich exakt im gleichen Winkel steht.

SEO, Google und das große Missverständnis

In SEO‑Zirkeln kursiert ein Mythos: Google straft KI‑Texte ab. Tja, falsch. Google selbst hat mehrfach klargestellt, dass es nicht danach geht, wer den Text geschrieben hat, sondern wie gut er ist. Wenn ein Text hilfreich, einzigartig und relevant ist, ist es total egal, ob er von einem Menschen oder einer Maschine stammt.

Das bedeutet: Ein KI‑generierter Text kann gut ranken, wenn er:

- echten Mehrwert bietet

- fachliche Tiefe zeigt

- keine dünne, generische Masse ist

Und das Gegenteil gilt genauso: Ein miserabler humaner Text fliegt schneller aus den Suchergebnisseiten als ein gut formulierter KI‑Text, der redaktionell überarbeitet wurde.

SEO im KI‑Zeitalter bedeutet also:

Menschliches Feingefühl + maschinelle Power + redaktioneller Schliff = Sieg.

Authentizität im KI‑Zeitalter

Also, was nehmen wir mit aus dieser wilden Reise durch Schreibstile, Algorithmen und Fake‑Detektoren?

- Die Antwort „Mensch oder KI?“ lässt sich nicht absolut beantworten – zumindest nicht mit 100-prozentiger Sicherheit.

- Detektoren sind Werkzeuge, keine Wahrheitsinstanzen. Sie helfen einzuschätzen, nicht zu beweisen.

- Für SEO zählt nicht, wer den Text geschrieben hat, sondern nur wie gut der Text ist – und ob er echten Mehrwert liefert.

- Hybrid‑Workflows (Mensch + KI) sind oft die Zukunft der Content‑Creation‑Suites.

Am Ende seid ihr hier gefragt: Eure Stimme, eure Kreativität, gepaart mit einem kritischen Blick auf Tools und Daten, macht den Unterschied aus. Das ist der wahre Indikator für Authentizität und Qualität – und der einzige, der Leser*innen, Ranking‑Algorithmen und KI‑Assistenten gleichermaßen beeindruckt.

Fazit: KI Text Erkennung ist nicht aussagekräftig

Ihr habt es jetzt schwarz auf weiß: Die KI Text Erkennung ist keine Binärfrage, sondern ein Spektrum. Es gibt Tools, die Hinweise geben, Studien, die warnen, und Intuitionen, die manchmal besser sind als die Detektoren.

Nachtrag: Ein kleiner Text-Test

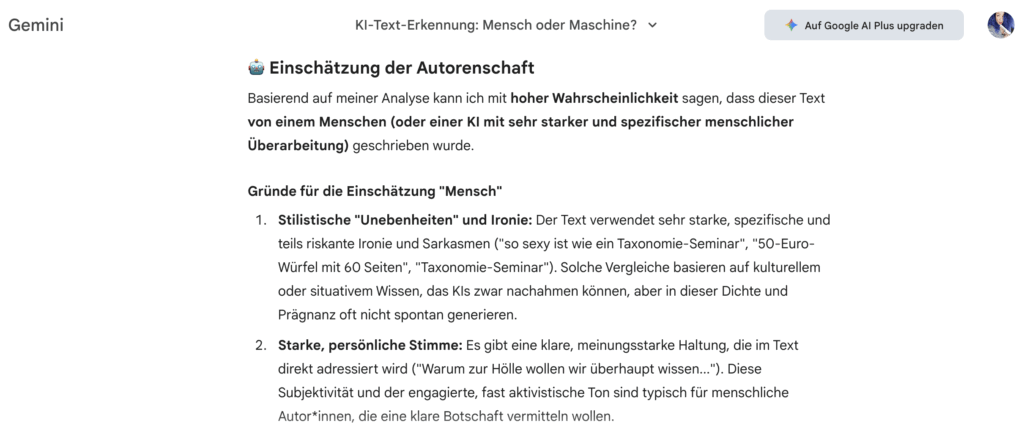

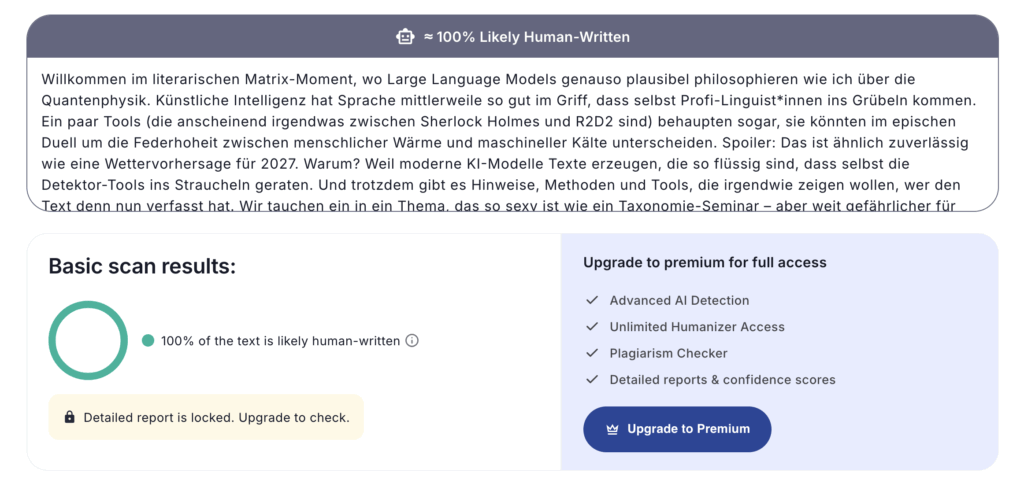

Ah – und bevor ich’s vergesse: Dieser Text wurde von mir geschrieben – aber ich habe trotz des Wissens darum mal bei Gemini und Co nach einer KI Text Erkennung gefragt:

Schreibe einen Kommentar